Sự tấn công của các bot xấu là một trong những nguyên nhân hàng đầu khiến website bị chậm, tiêu tốn băng thông và tụt hạng SEO mà nhiều người không để ý. Bài viết này sẽ hướng dẫn bạn chi tiết các cách để nhận diện và chặn đứng hoạt động của bot xấu một cách triệt để, đảm bảo không ảnh hưởng đến SEO và trải nghiệm người dùng thật trên hầu hết các loại website hiện nay.

Bot xấu ảnh hưởng đến website như thế nào?

Lưu lượng truy cập bất thường từ các bot xấu như AI crawler, scraper dữ liệu và bot tấn công DDoS gây ảnh hưởng nghiêm trọng đến hiệu năng và sự ổn định của website. Các hoạt động này dẫn đến những tác động tiêu cực như tiêu tốn tài nguyên máy chủ, làm chậm tốc độ tải trang, khai thác trái phép nội dung và suy giảm trải nghiệm người dùng, qua đó ảnh hưởng xấu đến thứ hạng SEO và uy tín của doanh nghiệp.

3 cách chặn bot xấu truy cập vào website nhanh chóng

Cách 1: Sử dụng file robots.txt (áp dụng cho mọi website)

Cách 2: Chặn bằng file .htaccess (dành cho server Apache/ LiteSpeed/ OpenLiteSpeed)

Cách 3: Chặn trên server Nginx

Cách 1: Sử dụng file robots.txt (áp dụng cho mọi website)

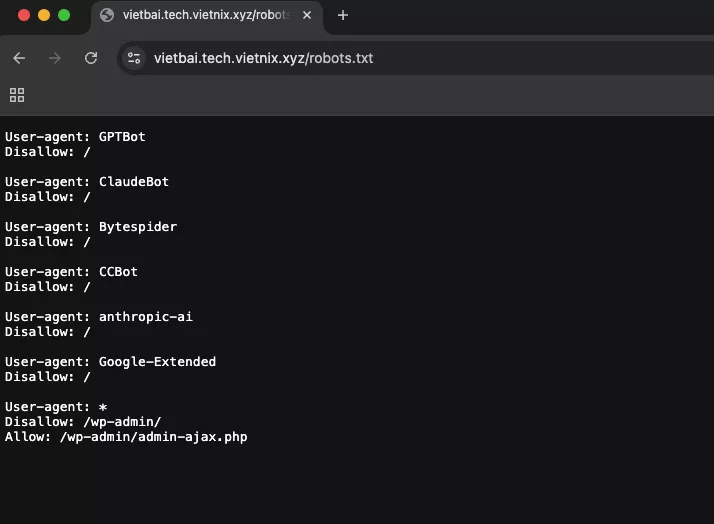

Tệp robots.txt cung cấp chỉ thị cho các bot về việc không thu thập dữ liệu tại một số khu vực nhất định trên website.

Bước 1: Truy cập vào trình quản lý tệp (File Manager) trên giao diện quản trị hosting (cPanel) hoặc thông qua giao thức FTP.

Bước 2: Tiến hành tạo mới hoặc chỉnh sửa tệp robots.txt tại thư mục gốc của website (thường là public_html).

Bước 3: Bổ sung các quy tắc sau để ngăn chặn hoạt động của các bot độc hại và bot thu thập dữ liệu AI phổ biến:

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: Bytespider

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: anthropic-ai

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.phpBước 4: Sau khi hoàn tất, lưu lại các thay đổi và xác thực cấu hình bằng cách truy cập vào đường dẫn yourdomain.com/robots.txt.

![]() Lưu ý

Lưu ý

Tệp robots.txt chỉ đưa ra yêu cầu chứ không có khả năng ngăn chặn thực sự. Các bot từ những đơn vị uy tín (như Google, Bing) sẽ tuân thủ, nhưng các bot độc hại sẽ hoàn toàn phớt lờ những quy tắc này. Vì vậy, chỉ dựa vào robots.txt là không đủ, bạn cần phải kết hợp thêm các biện pháp bảo mật khác để bảo vệ website.

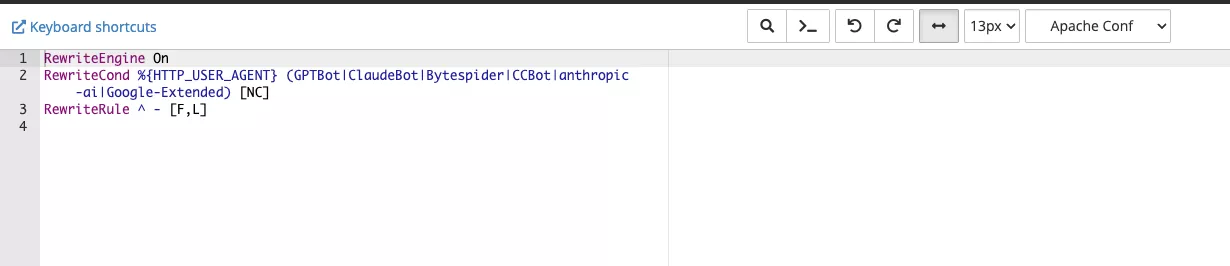

Cách 2: Chặn bằng file .htaccess (dành cho server Apache/ LiteSpeed/ OpenLiteSpeed)

Thực hiện theo các bước sau:

Bước 1: Truy cập và chỉnh sửa tệp.htaccess nằm tại thư mục gốc của website.

Bước 2: Bổ sung đoạn code dưới đây vào tệp để cấu hình chặn truy cập dựa trên User-Agent:

RewriteEngine On

RewriteCond %{HTTP_USER_AGENT} (GPTBot|ClaudeBot|Bytespider|CCBot|anthropic-ai|Google-Extended) [NC]

RewriteRule ^ - [F,L]

Bước 3: Thay thế danh sách User-Agent trong dấu ngoặc đơn () bằng các bot không mong muốn mà bạn muốn chặn.

Bước 4: Lưu lại các thay đổi và kiểm tra hoạt động của website để đảm bảo không phát sinh Lỗi 500 (Internal Server Error) do cấu hình sai.

Cách 3: Chặn trên server Nginx

Để thực hiện, hãy làm theo các bước sau:

Bước 1: Chỉnh sửa tệp cấu hình Nginx của trang web. Đường dẫn phổ biến của tệp này là /etc/nginx/sites-available/your-site.

Bước 2: Bên trong block server { ... }, hãy thêm đoạn code sau để từ chối các yêu cầu từ những User-Agent không mong muốn:

if ($http_user_agent ~* (GPTBot|ClaudeBot|Bytespider|CCBot|badbot)) {

return 403;

}Lưu các thay đổi, sau đó kiểm tra cú pháp cấu hình và tải lại dịch vụ Nginx để áp dụng:

sudo nginx -t && sudo systemctl reload nginx.Kiểm tra kết quả sau khi chặn bot xấu

Sau khi thực hiện các cách bên trên bạn có thể sử dụng 2 cách dưới đây để kiểm tra kết quả:

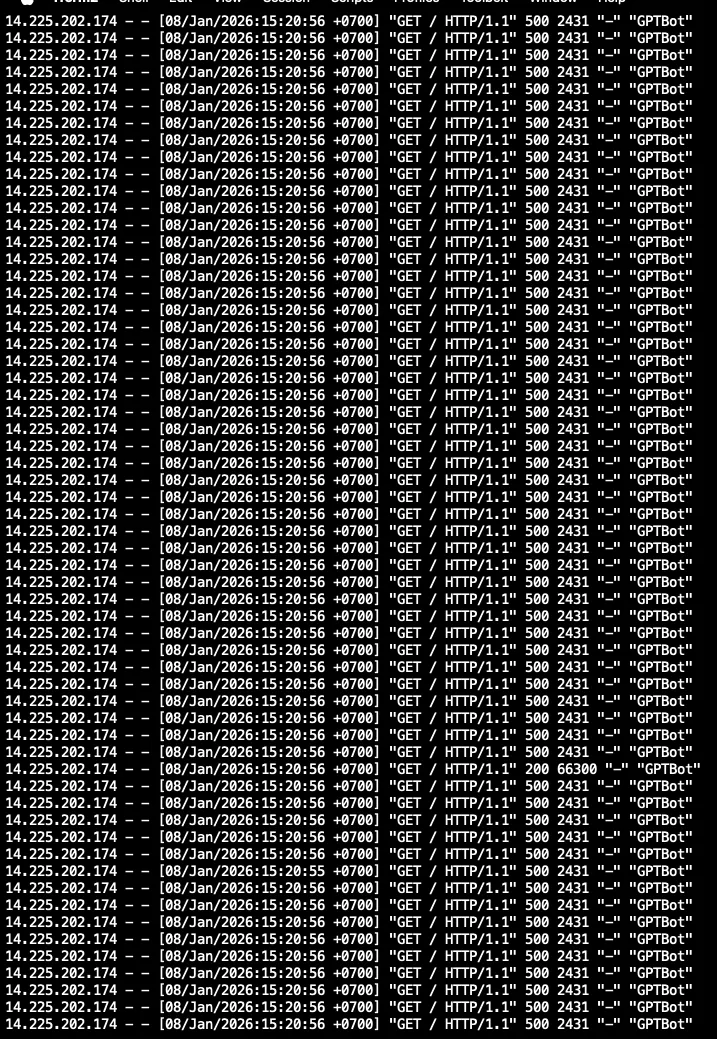

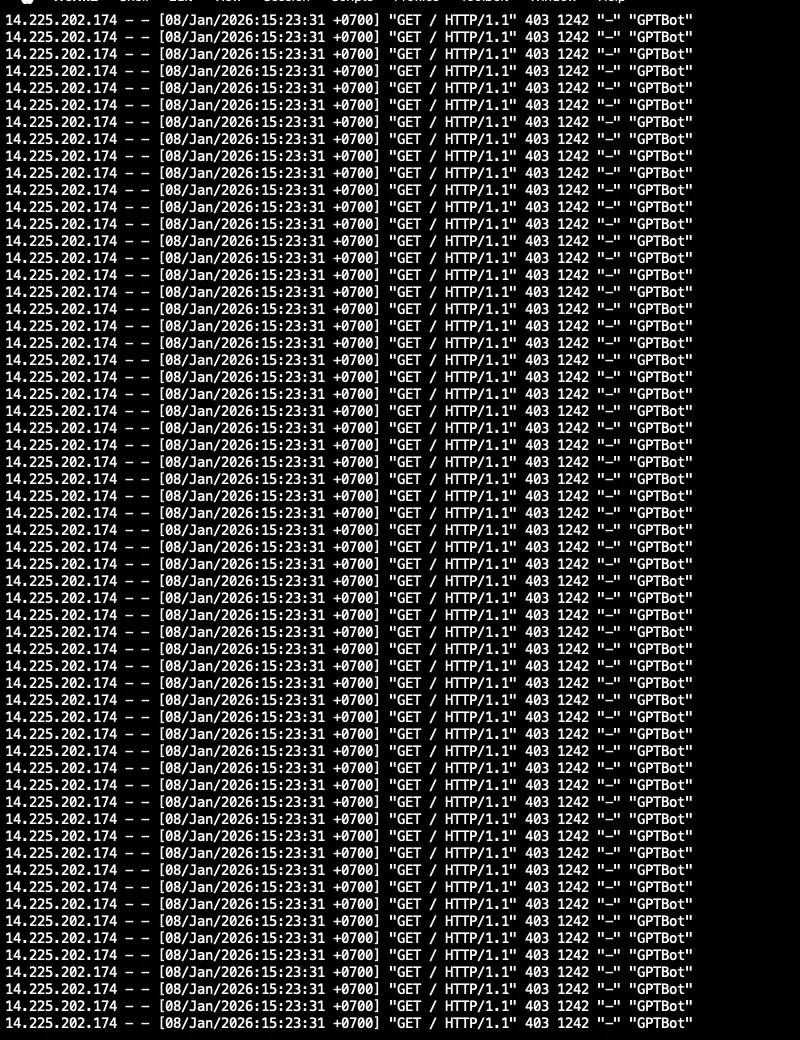

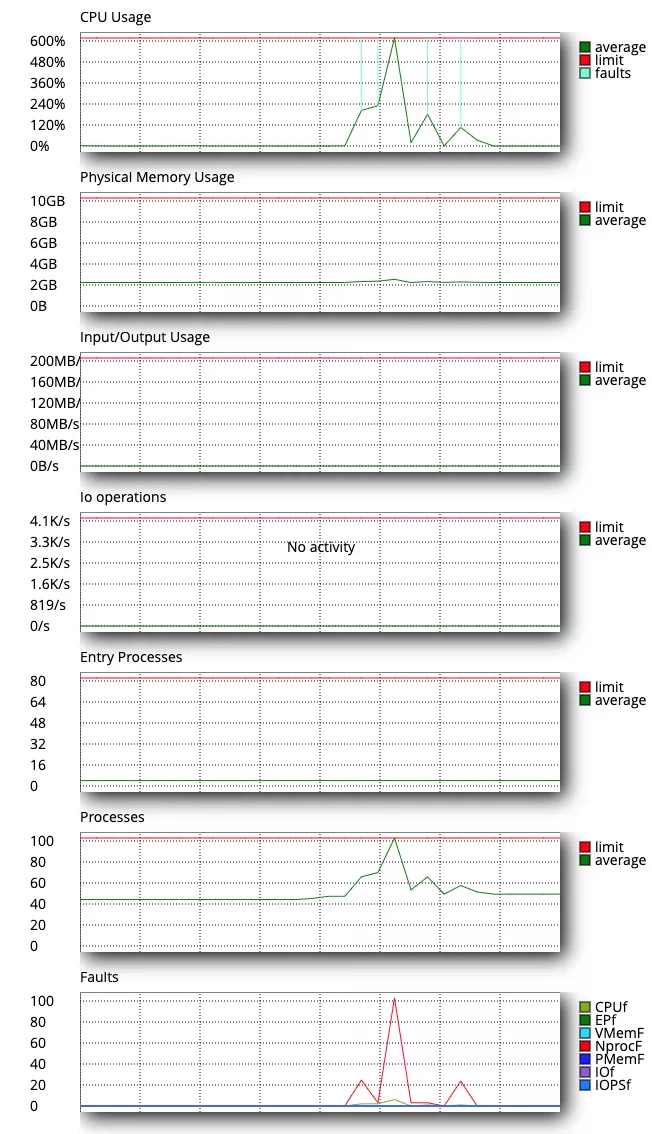

- Phân tích tệp nhật ký truy cập của máy chủ (ví dụ:

access.log) để xác minh rằng lưu lượng truy cập từ các bot bị chặn đã giảm đáng kể. - Theo dõi các chỉ số về hiệu suất, chẳng hạn như tốc độ tải trang và mức sử dụng băng thông của hosting, để nhận thấy những cải thiện sau khi áp dụng.

Một số lỗi phổ biến khi chặn bot xấu truy cập website

Trong quá trình thực hiện, bạn có thể gặp phải một số lỗi không mong muốn. Hãy tham khảo các giải pháp sau đây:

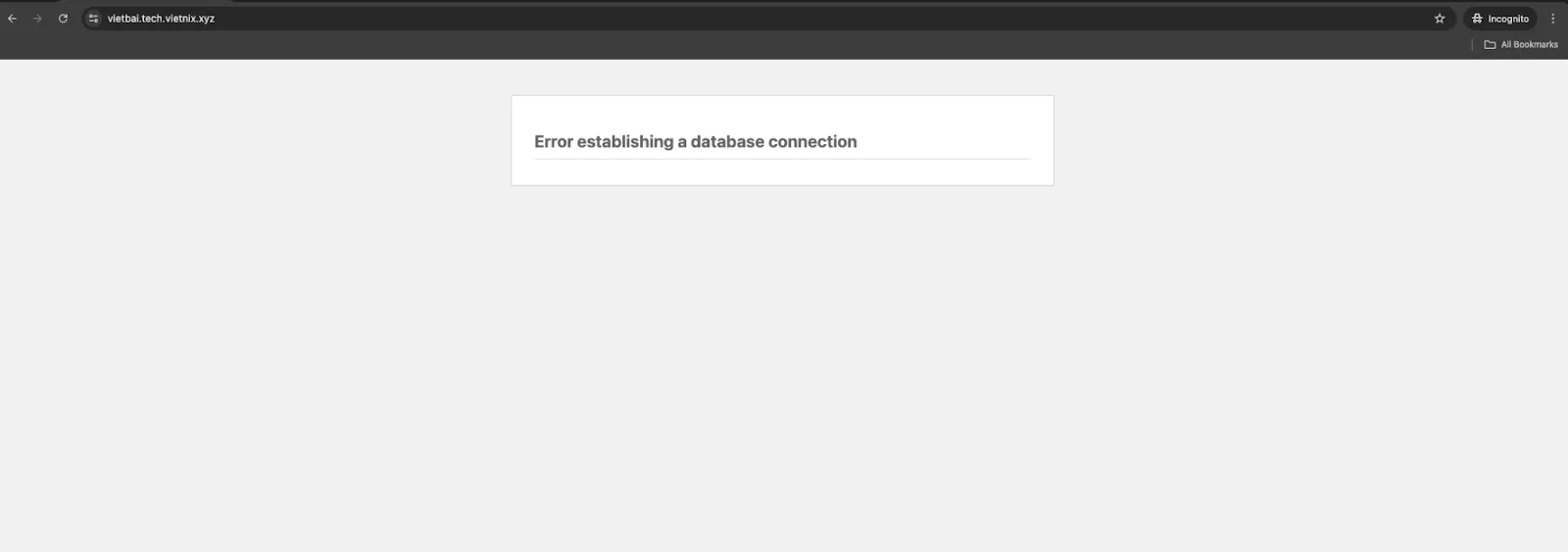

- Trang web trả về lỗi 403 hoặc 500: Nguyên nhân có thể do lỗi cú pháp trong tệp cấu hình. Hãy kiểm tra kỹ lại đoạn mã bạn đã thêm. Luôn tạo bản sao lưu (backup) tệp cấu hình trước khi tiến hành chỉnh sửa để có thể khôi phục khi cần thiết.

- Chặn nhầm các bot hữu ích: Nếu bạn phát hiện đã chặn nhầm các bot từ công cụ tìm kiếm như Googlebot hoặc Bingbot, hãy cập nhật lại quy tắc để loại bỏ chúng khỏi danh sách bị chặn (đưa vào “whitelist”).

Như vậy, bạn đã hoàn tất các bước cần thiết để chặn hầu hết bot xấu mà không ảnh hưởng đến SEO. Hy vọng hướng dẫn chi tiết này sẽ giúp bạn áp dụng thành công, qua đó giúp website hoạt động nhanh hơn, an toàn hơn và tiết kiệm tài nguyên đáng kể. Đây là một bước chuẩn bị quan trọng, đặc biệt trong bối cảnh năm 2026 khi bot AI ngày càng phổ biến. Nếu có bất cứ thắc mắc nào trong quá trình thực hiện, bạn có thể liên hệ trực tiếp với Vietnix để được hỗ trợ.

VIETNIX – DỊCH VỤ HOSTING, VPS TỐC ĐỘ CAO, ỔN ĐỊNH, BẢO MẬT

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

- Điện thoại: 1800 1093

- Email liên hệ: sales@vietnix.com.vn

- Website: https://vietnix.vn/