Việc tìm kiếm các giải pháp chạy mô hình ngôn ngữ lớn (LLM) vừa mạnh mẽ vừa tiết kiệm chi phí luôn là ưu tiên hàng đầu của các nhà phát triển. Kimi K-2.5, với sự hỗ trợ chuẩn API tương thích OpenAI/Anthropic, có thể dễ dàng tích hợp vào hệ thống OpenClaw. Bài viết này sẽ hướng dẫn bạn chi tiết cách thiết lập và sử dụng Kimi K-2.5 kết hợp cùng OpenClaw hoàn toàn miễn phí, giúp bạn tự xây dựng các trợ lý AI đa phương thức với hiệu suất cao và bảo mật dữ liệu tối đa.

Chuẩn bị môi trường cài đặt

Tính đến thời điểm hiện tại, OpenClaw hoạt động ổn định nhất trong môi trường Linux. Do đó, nếu bạn đang sử dụng Windows, giải pháp tốt nhất là sử dụng WSL2 (Windows Subsystem for Linux 2) kết hợp với Ubuntu.

Cài đặt WSL2 + Ubuntu trên Windows

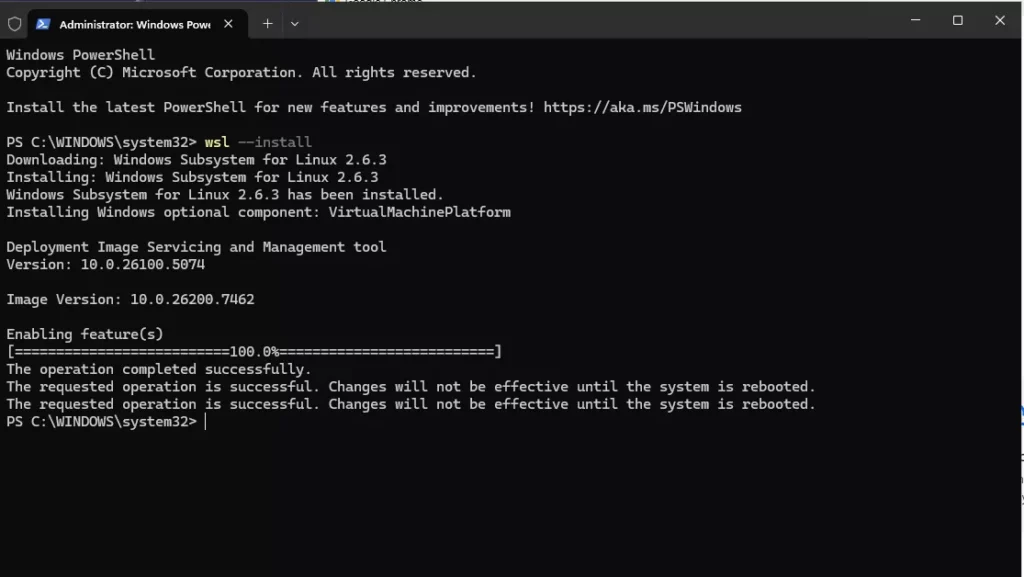

Bạn mở ứng dụng PowerShell hoặc Windows Terminal với quyền Quản trị viên (Run as Administrator) và chạy lệnh cài đặt duy nhất sau đây:

wsl --installLệnh này sẽ tự động bật các tính năng cần thiết, tải kernel WSL mới nhất và cài đặt bản phân phối Ubuntu mặc định.

Bạn khởi động lại máy tính khi hệ thống yêu cầu.

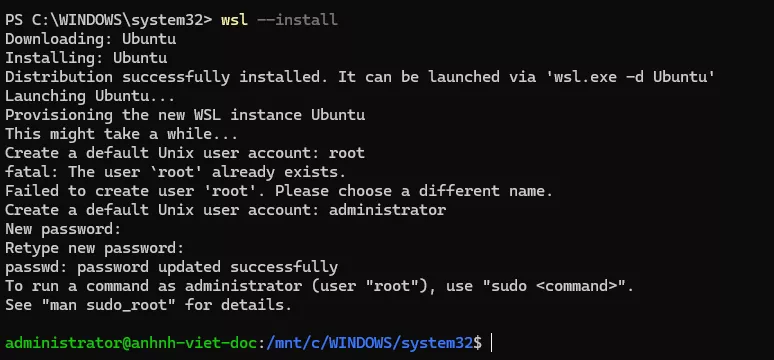

Sau khi khởi động lại, cửa sổ terminal của Ubuntu sẽ tự động mở. Bạn hãy chờ vài phút để quá trình thiết lập hoàn tất, sau đó tạo Tên người dùng (Username) và Mật khẩu (Password) cho hệ điều hành Linux của mình.

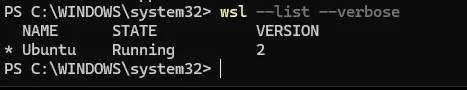

Để kiểm tra WSL2 đã hoạt động chuẩn chưa, bạn mở lại PowerShell và chạy lệnh:

wsl --list --verboseNếu kết quả hiển thị trạng thái Running và phiên bản 2, bạn đã cài đặt thành công.

Cài đặt Node.js và pnpm trên Ubuntu

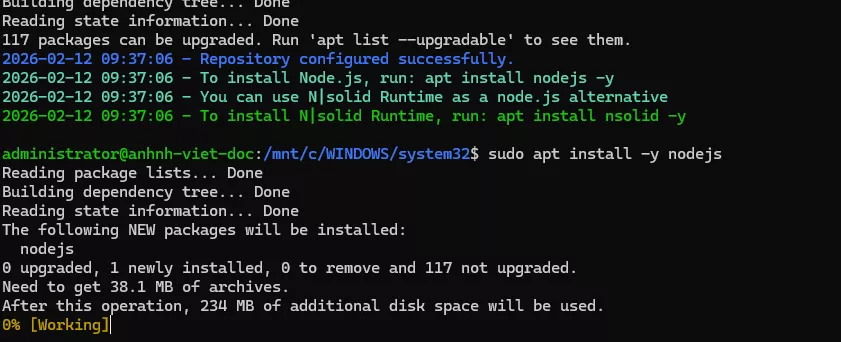

OpenClaw yêu cầu phiên bản Node.js từ 24 trở lên. Bạn mở terminal Ubuntu và thực hiện tuần tự các lệnh sau:

Tải và cài đặt Node.js:

curl -fsSL https://deb.nodesource.com/setup_24.x | sudo -E bash -

sudo apt install -y nodejs

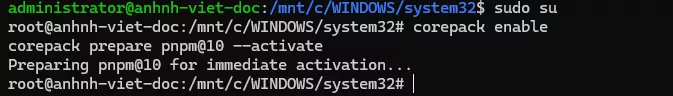

Bật Corepack và thiết lập pnpm phiên bản 10:

corepack enable

corepack prepare pnpm@10 --activate

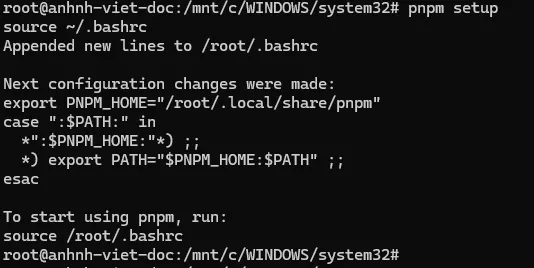

Thiết lập đường dẫn và xác minh:

pnpm setup

source ~/.bashrc

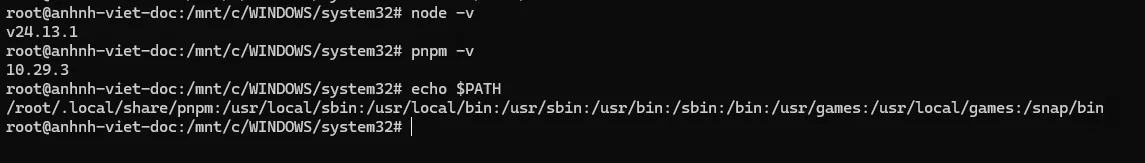

Cuối cùng bạn kiểm tra lại phiên bản để đảm bảo cài đặt thành công:

node -v # Kết quả phải hiển thị >= 24

pnpm -v # Kết quả phải hiển thị 10.x

echo $PATH # Kết quả phải bao gồm ~/.local/share/pnpm

Các bước cấu hình Kimi K-2.5 vài OpenClaw

Bước 1: Cài đặt OpenClaw

Để cài đặt OpenClaw, bạn không nên sử dụng các gói npm cũ. Thay vào đó, bạn hãy sử dụng trình cài đặt chính thức thông qua lệnh sau trong terminal Ubuntu:

curl -fsSL https://openclaw.ai/install.sh | bashSau khi cài đặt xong, bạn tải lại shell để cập nhật các biến môi trường:

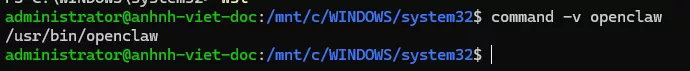

source ~/.bashrcSau khi quá trình hoàn tất, bạn có thể kiểm tra xem công cụ đã được nhận diện hay chưa bằng lệnh:

command -v openclaw

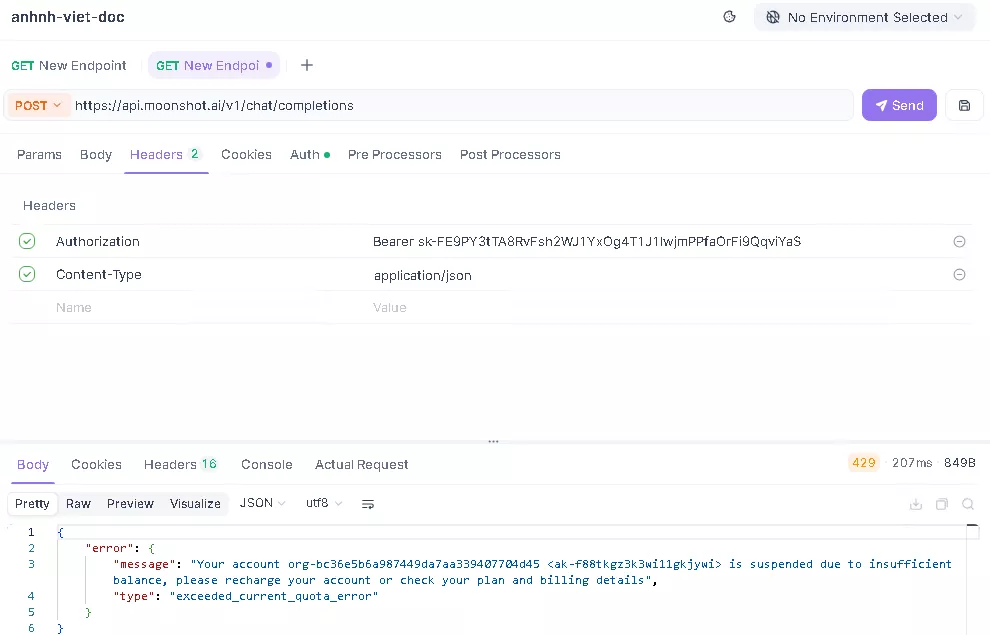

Bước 2: Kiểm tra Endpoint Kimi K-2.5 bằng Apidog

Để tránh mất thời gian gỡ lỗi sau này, bạn nên xác thực quyền truy cập API của Kimi K-2.5 trước khi cấu hình vào OpenClaw. Bạn có thể sử dụng công cụ Apidog trên Windows để kiểm tra:

Bạn mở Apidog, tạo một yêu cầu POST mới đến URL: https://api.moonshot.ai/v1/chat/completions

Trong phần Headers, bạn cấu hình:

- Authorization: Bearer sk-your-moonshot-key (Thay bằng API key của bạn).

- Content-Type: application/json.

Trong phần Body, bạn dán đoạn mã JSON sau:

{

"model": "kimi-k2.5",

"messages":[

{

"role": "user",

"content": "Confirm you are Kimi K-2.5 and describe three key capabilities."

}

],

"temperature": 0.7,

"max_tokens": 256

}Sau đó bạn nhấn Send. Nếu hệ thống trả về mã 200 OK kèm nội dung phản hồi từ AI, khóa API của bạn đã hoạt động hoàn hảo.

Bước 3: Tích hợp cấu hình vào OpenClaw

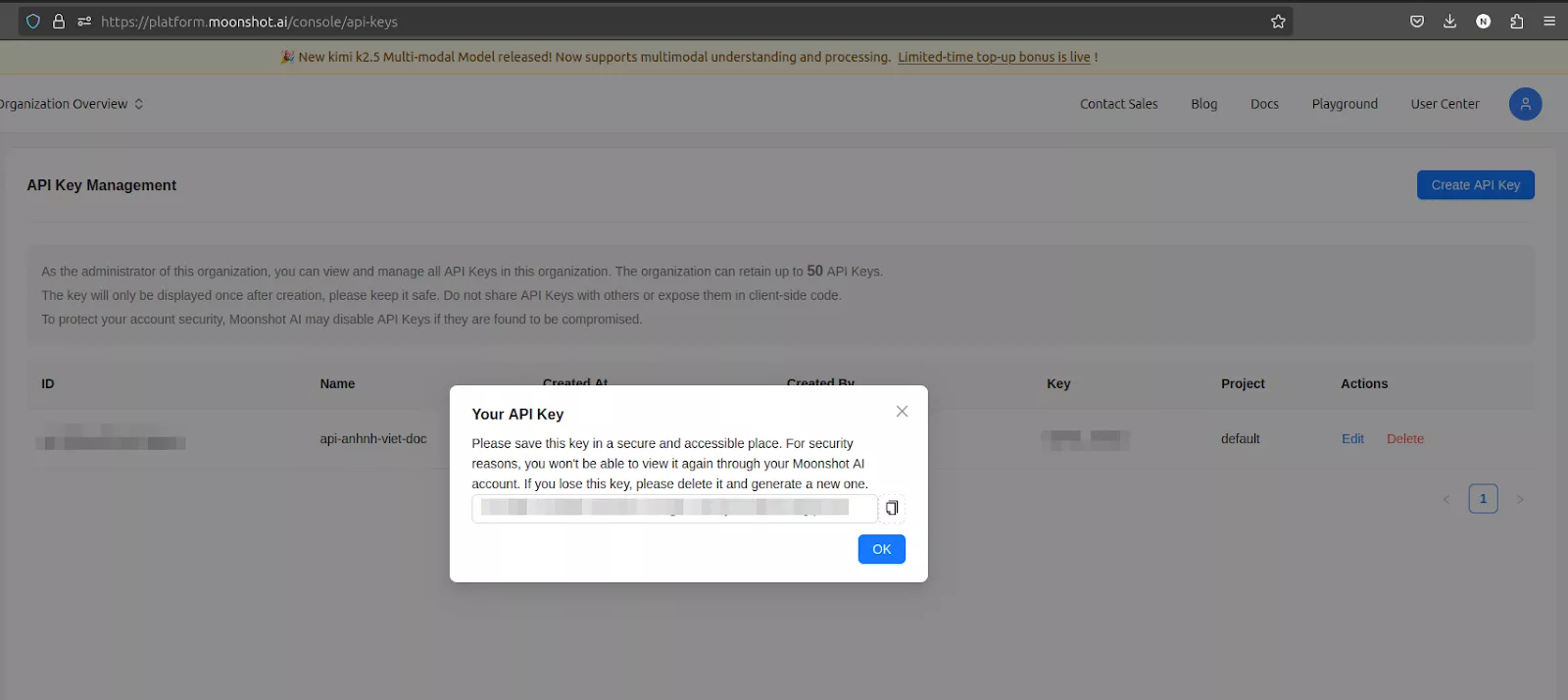

Bạn tạo một tài khoản tại trang chủ của Moonshot API (platform.moonshot.ai) và tạo một khóa API mới (sk-…).

Sau đó bạn sử dụng trình soạn thảo văn bản để chỉnh sửa file cấu hình ~/.openclaw/openclaw.json bên trong Ubuntu với nội dung như sau (thay sk-your-moonshot-key bằng khóa API của bạn):

{

"agent": {

"model": { "primary": "moonshot/kimi-k2.5" }

},

"models": {

"providers": {

"moonshot": {

"baseUrl": "https://api.moonshot.ai/v1",

"apiKey": "sk-your-moonshot-key",

"api": "openai-completions",

"models":[

{

"id": "kimi-k2.5",

"name": "Kimi K-2.5 API 256K",

"contextWindow": 262144,

"maxTokens": 8192

}

]

}

}

}

}Bạn lưu file và khởi động lại dịch vụ bằng lệnh sau để áp dụng cấu hình:

openclaw restartBước 4: Triển khai Kimi K-2.5 cục bộ (tùy chọn)

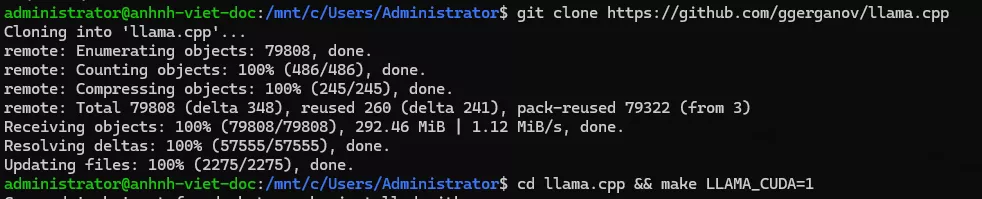

Nếu máy tính của bạn có Card đồ họa (GPU) mạnh và bạn muốn sử dụng mô hình hoàn toàn miễn phí, không giới hạn thì có thể chạy mô hình trực tiếp trên máy (Local) bằng llama.cpp.

Đầu tiên bạn cài đặt các công cụ cần thiết và clone mã nguồn llama.cpp:

sudo apt install build-essential cmake git

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp && make LLAMA_CUDA=1

Để cài đặt và tải trọng số mô hình Kimi K-2.5 GGUF từ Hugging Face:

pip install -U huggingface_hub # Cài đặt huggingface-hub

huggingface-cli download unsloth/Kimi-K2.5-GGUF --local-dir ./kimi-ggufBạn khởi động máy chủ ảo tương thích với OpenAI API:

./llama-server -m ./kimi-gguf/kimi-k2.5-UD-IQ2_XXS.gguf --port 8080 --ctx-size 32768 --n-gpu-layers 99 --host 0.0.0.0 --flash-attnCuối cùng, bạn cập nhật lại file openclaw.json để trỏ baseUrl về http://127.0.0.1:8080/v1:

{

"agent": { "model": { "primary": "local-kimi/kimi-k2.5" } },

"models": {

"providers": {

"local-kimi": {

"baseUrl": "http://127.0.0.1:8080/v1",

"apiKey": "sk-no-key-required",

"api": "openai-completions",

"models": [

{ "id": "kimi-k2.5-local", "name": "Kimi K-2.5 Local GGUF", "contextWindow": 32768, "maxTokens": 4096 }

]

}

}

}

}Khởi động lại OpenClaw bằng lệnh openclaw restart.

Mẹo tối ưu hóa hiệu suất Kimi K-2.5 trên OpenClaw

Để hệ thống hoạt động mượt mà, bạn nên áp dụng các tinh chỉnh sau:

- Bạn hãy đảm bảo thông số contextWindow trong cấu hình JSON khớp chính xác với cờ

--ctx-sizekhi chạy máy chủ cục bộ. - Đối với các tác vụ yêu cầu độ chính xác cao như lập trình, bạn nên giảm thông số temperature xuống mức 0.6 – 0.8.

- Khi chạy local, bạn hãy thêm cờ

--flash-attntrong llama.cpp để tăng tốc độ xử lý từ 20% đến 40%. - Bạn nên theo dõi dung lượng VRAM liên tục bằng lệnh

nvidia-smiđể điều chỉnh số lớp GPU tải lên cho phù hợp.

Các lỗi thường gặp và cách xử lý

Trong quá trình sử dụng, bạn có thể gặp phải một số vấn đề kỹ thuật. Dưới đây là danh sách các lỗi phổ biến và cách khắc phục:

- Lỗi 401 Unauthorized: Khóa API của bạn không hợp lệ. Bạn hãy kiểm tra lại khóa bằng Apidog.

- Lỗi tràn ngữ cảnh: Lịch sử hội thoại quá dài. Bạn hãy giảm tham số –ctx-size khi chạy server cục bộ hoặc tóm tắt lại lịch sử trò chuyện.

- Mô hình cục bộ chạy chậm: Hiệu suất GPU không đủ. Bạn có thể giảm số lớp được tải lên GPU (

--n-gpu-layers) hoặc sử dụng phiên bản lượng tử hóa thấp hơn (ví dụ: Q4 thay vì Q8). - Không có phản hồi trong cuộc trò chuyện: Dịch vụ có thể đã gặp lỗi. Bạn cần kiểm tra nhật ký của OpenClaw và khởi động lại dịch vụ (bằng lệnh

openclaw restart).

Việc kết hợp Kimi K-2.5 cùng OpenClaw sẽ giúp bạn sở hữu một hệ sinh thái AI mạnh mẽ và vô cùng linh hoạt. Bạn nên bắt đầu bằng gói API miễn phí của Moonshot để làm quen, sau đó chuyển sang chạy cục bộ nếu có phần cứng phù hợp và yêu cầu cao về bảo mật dữ liệu. Nếu có bất cứ thắc mắc nào trong quá trình cài đặt Server/VPS để chạy mô hình, bạn có thể liên hệ trực tiếp với Vietnix để được hỗ trợ nhanh chóng.

VIETNIX – DỊCH VỤ HOSTING, VPS TỐC ĐỘ CAO, ỔN ĐỊNH, BẢO MẬT

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

- Điện thoại: 1800 1093

- Email liên hệ: sales@vietnix.com.vn

- Website: https://vietnix.vn/