OpenClaw kết hợp với Ollama là giải pháp giúp bạn nhanh chóng tạo chatbot AI mạnh mẽ mà không cần đầu tư hạ tầng phức tạp hay chi phí vận hành cao. Thay vì chạy model nặng trên VPS, bạn có thể tận dụng sức mạnh Cloud để xử lý AI, trong khi OpenClaw đóng vai trò trung gian điều phối và kết nối với Telegram hoặc giao diện web. Trong bài viết này, bạn sẽ được hướng dẫn từng bước để triển khai chatbot AI đơn giản, miễn phí và có thể sử dụng ngay trên VPS cá nhân.

Điều kiện tiên quyết

Trước khi bắt đầu, hãy đảm bảo bạn đã có sẵn các thành phần sau:

- VPS: Đã cài đặt sẵn OpenClaw và có quyền truy cập qua SSH.

- Tài khoản Telegram: Để khởi tạo Bot qua

@BotFather(nếu bạn muốn dùng trên điện thoại). - Kết nối SSH: Sử dụng Terminal (macOS/Linux) hoặc PuTTY/MobaXterm (Windows).

Tại sao nên sử dụng Model Cloud thay vì Local?

1. Sự khác biệt giữa Cloud và Local

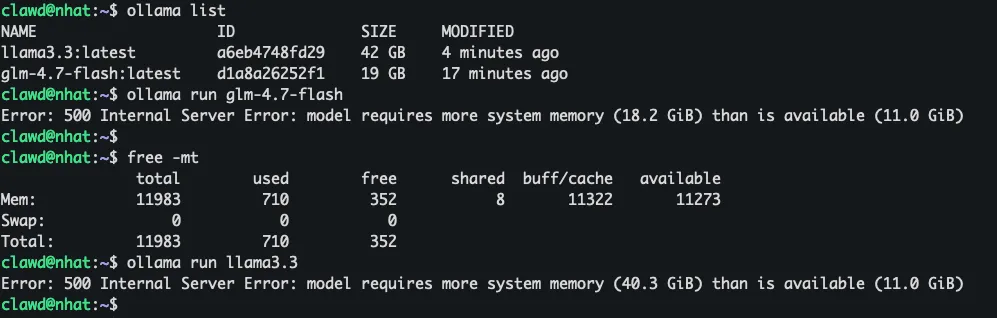

Việc chạy các model AI hoàn toàn cục bộ (Local) trên VPS thường gặp nhiều hạn chế như:

- Yêu cầu tài nguyên cực cao: Cần dung lượng RAM cùng ổ cứng lớn và CPU/GPU mạnh mẽ, không phù hợp với các gói VPS phổ thông.

- Tốc độ phản hồi chậm: Thời gian chờ đợi câu trả lời lâu, gây ảnh hưởng đến trải nghiệm người dùng.

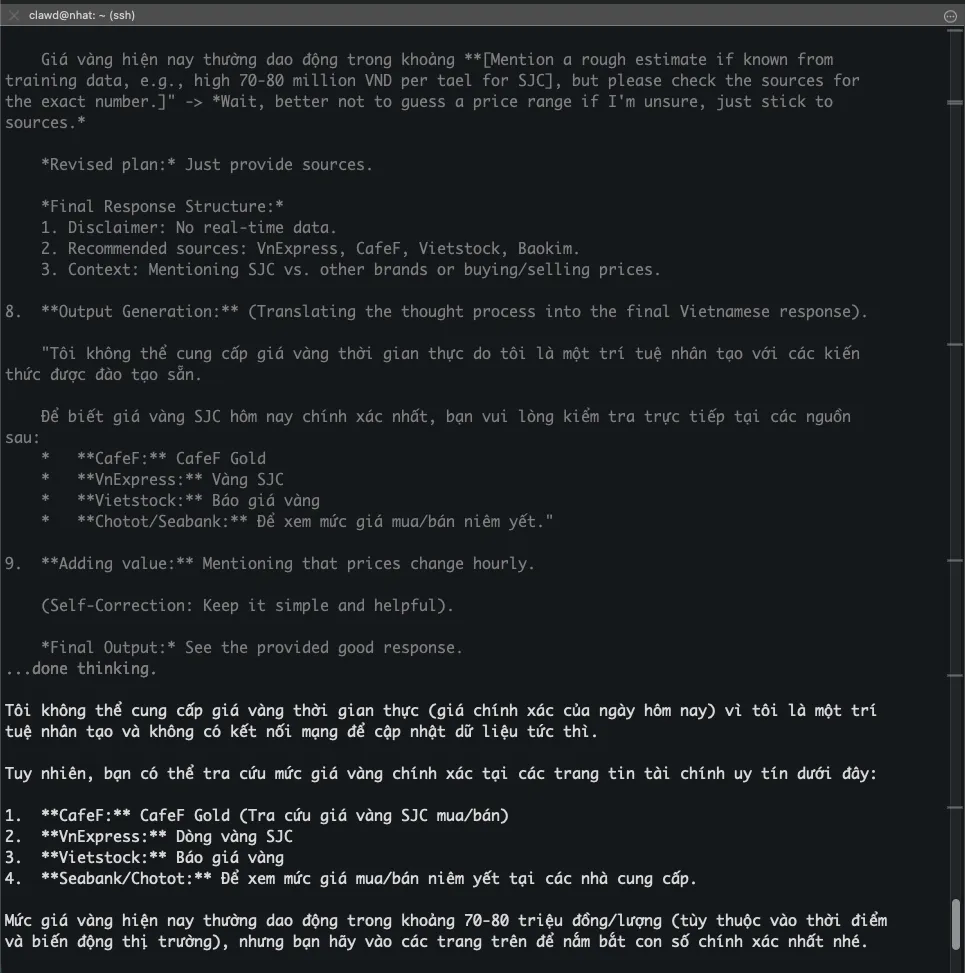

- Dữ liệu cũ: Các model local thường không có khả năng cập nhật thông tin thời gian thực.

Giải pháp tối ưu chính là sử dụng các model Cloud do Ollama cung cấp như qwen3.5:cloud hay kimi-k2.5:cloud.

Ưu điểm vượt trội:

- Gọn nhẹ: Giảm tải tối đa cho CPU và RAM của VPS, giúp hệ thống chạy mượt mà.

- Tốc độ: Phản hồi gần như tức thì, mang lại trải nghiệm trò chuyện tự nhiên.

- Độ chính xác cao: Dữ liệu luôn được cập nhật mới nhất từ nhà cung cấp model.

2. Nguyên lý hoạt động

Hệ thống hoạt động theo mô hình gateway + cloud inference:

User ➔ Telegram/Web ➔ OpenClaw Gateway (VPS) ➔ Ollama API (Local) ➔ Ollama Cloud (Xử lý) ➔ Trả kết quả ngược lại User.

Các bước thực hiện chi tiết

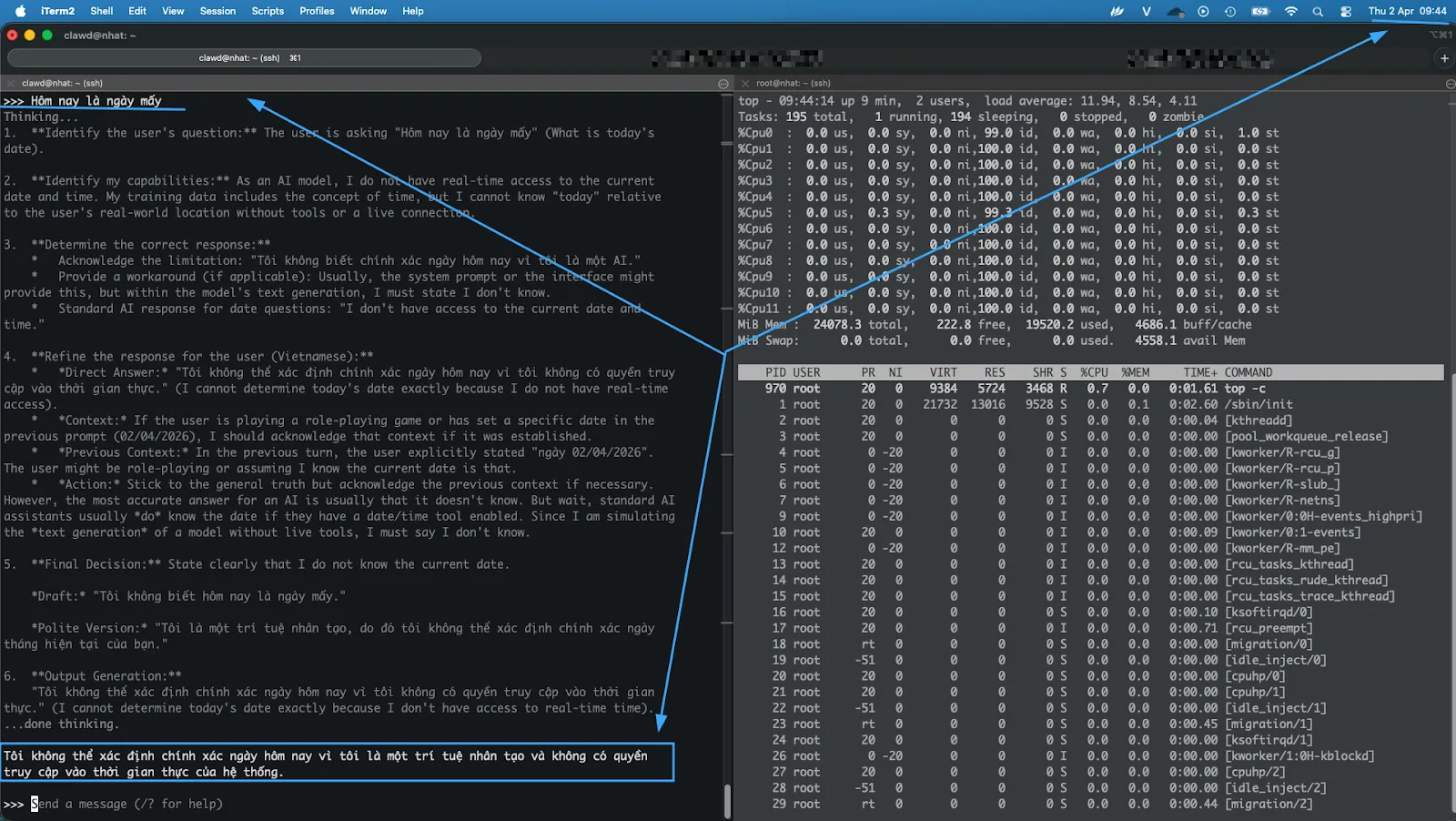

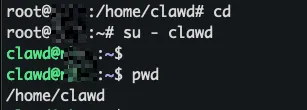

Bước 1: Truy cập SSH và chuyển quyền user

Đầu tiên, bạn hãy truy cập vào VPS qua SSH. Để đảm bảo an toàn và đúng cấu hình, bạn hãy chuyển sang user clawd (đây là user chuyên dụng chạy OpenClaw).

su - clawd

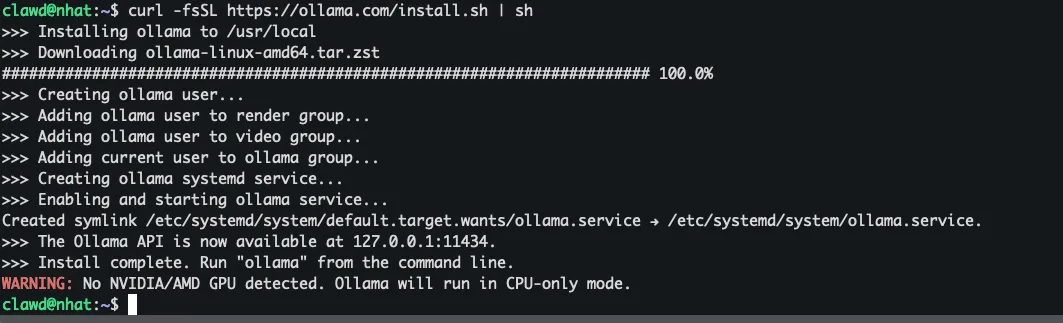

Bước 2: Cài đặt hoặc cập nhật Ollama

Hiện tại, Ollama sử dụng một lệnh duy nhất cho cả việc cài đặt mới và cập nhật:

curl -fsSL https://ollama.com/install.sh | sh

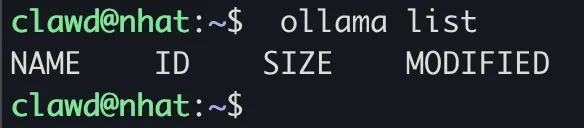

Sau khi cài xong, Ollama sẽ chưa có model nào. Bạn có thể kiểm tra bằng lệnh ollama list.

Bước 3: Tải model Ollama Cloud

Để sử dụng Ollama, bạn cần tải model về VPS. Lệnh sử dụng: ollama pull tên_model

Tùy vào nhu cầu, bạn có thể chọn một trong các model sau:

- Qwen 3.5:

ollama pull qwen3.5:397b-cloud - Kimi 2.5:

ollama pull kimi-k2.5:cloud - Minimax:

ollama pull minimax-m2.7:cloud

Bạn có thể tham khảo thêm các model khác tại thư viện của Ollama.

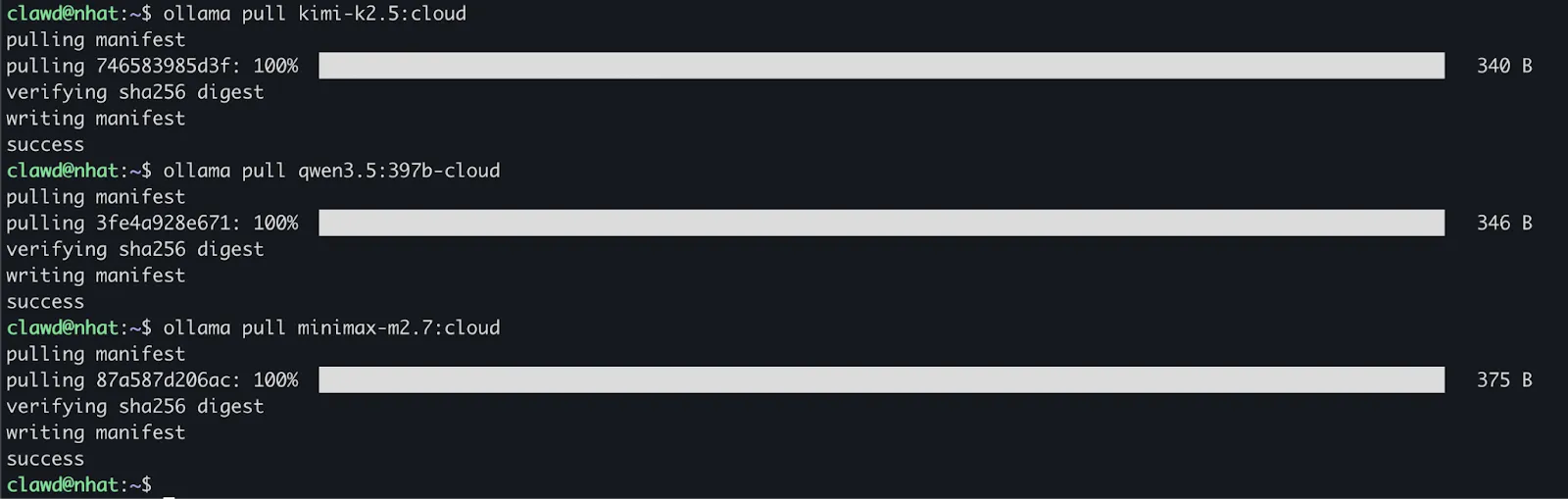

Bước 4: Đăng nhập Ollama Cloud

Vì đây là các model chạy trên hạ tầng Cloud, bạn bắt buộc phải xác thực tài khoản Ollama của mình. Bạn chạy lệnh sau:

ollama signinSao chép đường link xuất hiện trên màn hình console. Sau đó, bạn dán vào trình duyệt và thực hiện đăng nhập (hoặc đăng ký nếu chưa có tài khoản).

Sau khi trình duyệt báo thành công, VPS của bạn đã được cấp phép sử dụng Model Cloud.

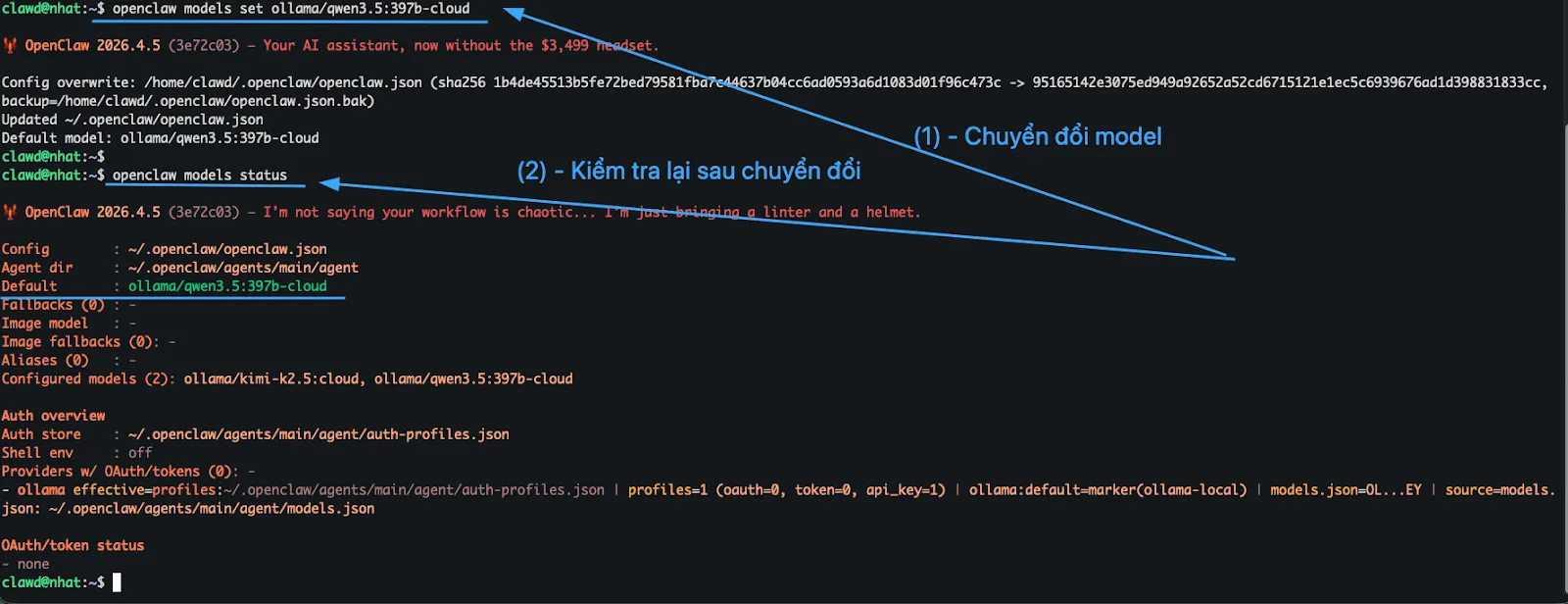

Bước 5: Cấu hình Model mặc định cho OpenClaw

Tiếp theo, bạn cần chỉ định cho OpenClaw biết cần sử dụng model nào làm mặc định.

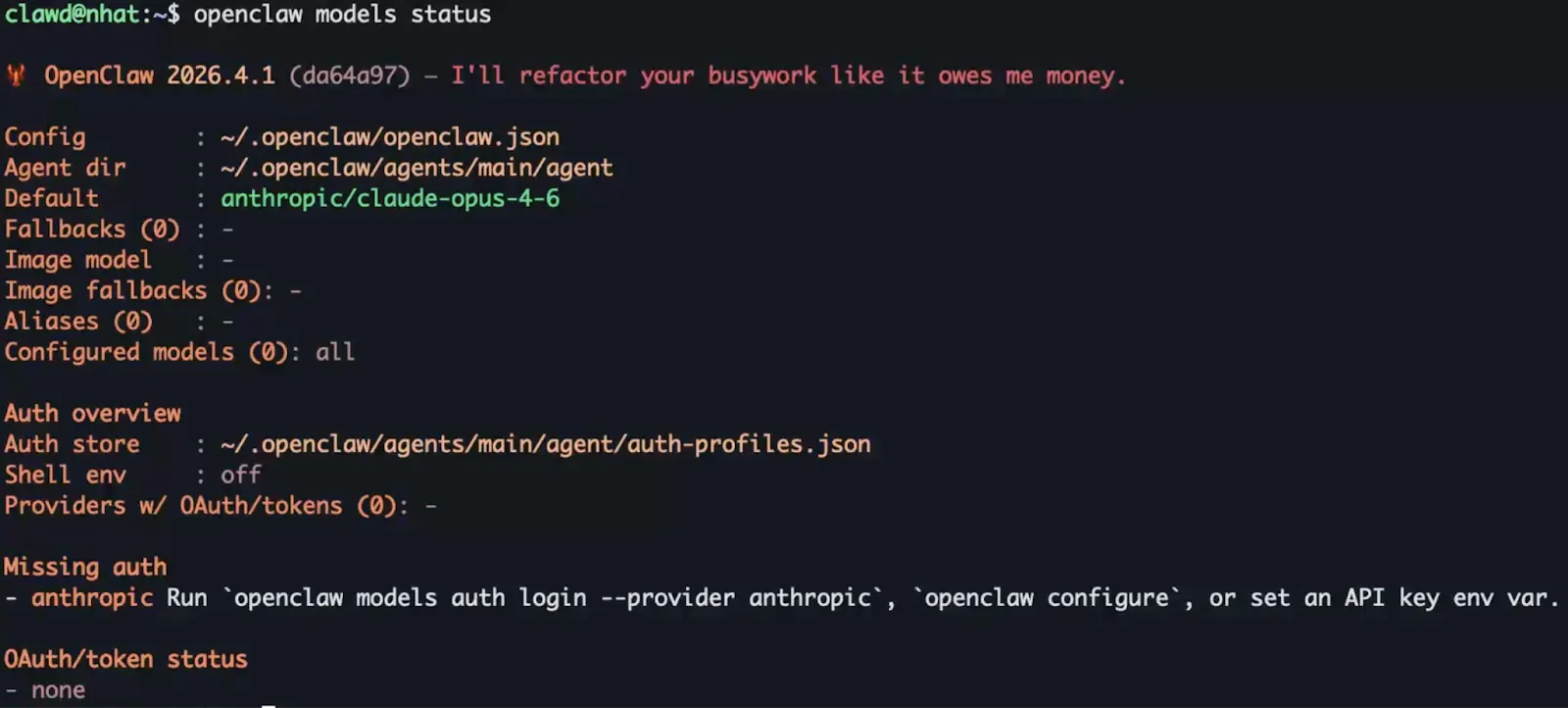

Kiểm tra model hiện tại bằng lệnh:

openclaw models status

Mặc định OpenClaw sử dụng model khác, để chuyển sang đúng model bạn cần sử dụng, bạn dùng dạng lệnh:

openclaw models set ollama/tên_modelVí dụ:

- Trường hợp sử dụng model:

qwen3.5:397b-cloud, dùng lệnh:openclaw models set ollama/qwen3.5:397b-cloud

- Trường hợp sử dụng model:

kimi-k2.5:cloud, dùng lệnh:openclaw models set ollama/kimi-k2.5:cloud

- Trường hợp sử dụng model:

minimax-m2.7:cloud, dùng lệnh:openclaw models set ollama/minimax-m2.7:cloud

Bước 6: Khởi chạy và sử dụng trên trình duyệt

6.1. Khởi chạy OpenClaw

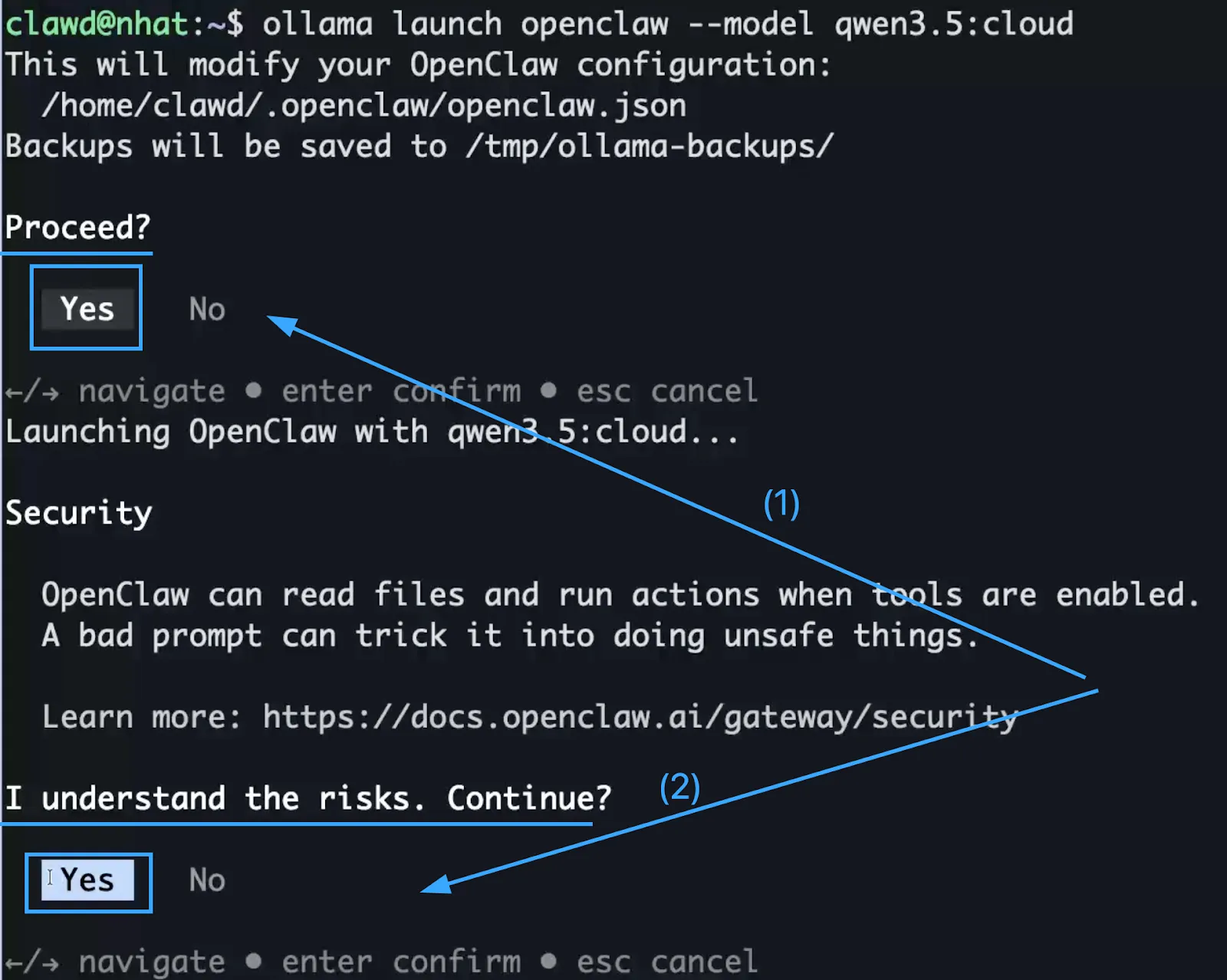

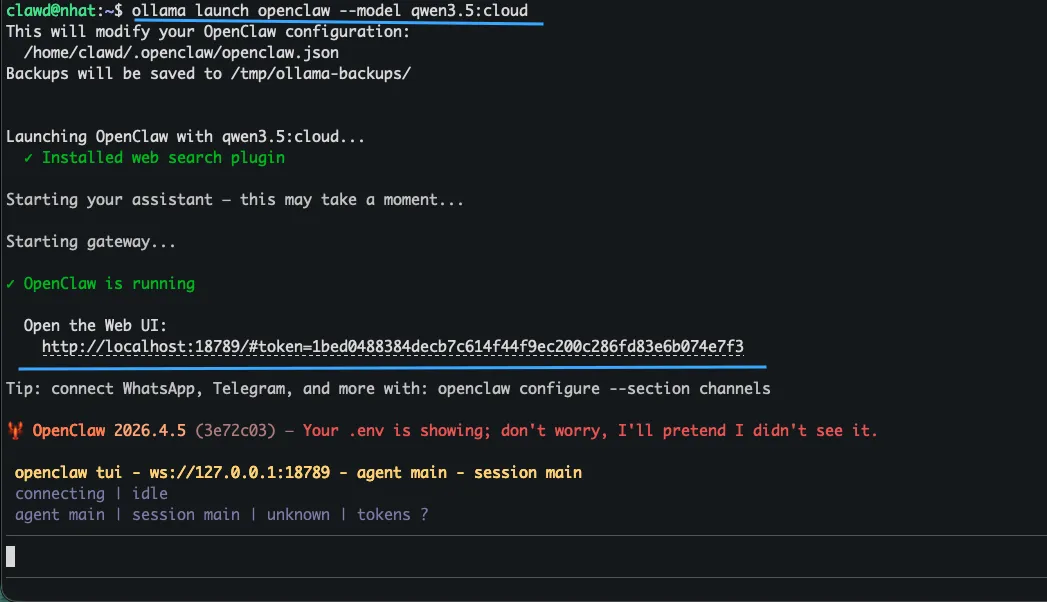

Để tương tác trực tiếp với chat AI bot ở trình duyệt, bạn cần khởi chạy OpenClaw với model đã chọn từ Ollama với lệnh: ollama launch openclaw --model qwen3.5:cloud (bạn thay model qwen3.5:cloud sang model bạn đang sử dụng).

Hệ thống sẽ hỏi để xác nhận một số rủi ro. Bạn hãy chọn Yes cho cả hai câu hỏi tương ứng bên dưới:

- Proceed? chọn Yes.

- I understand the risks. Continue? chọn Yes.

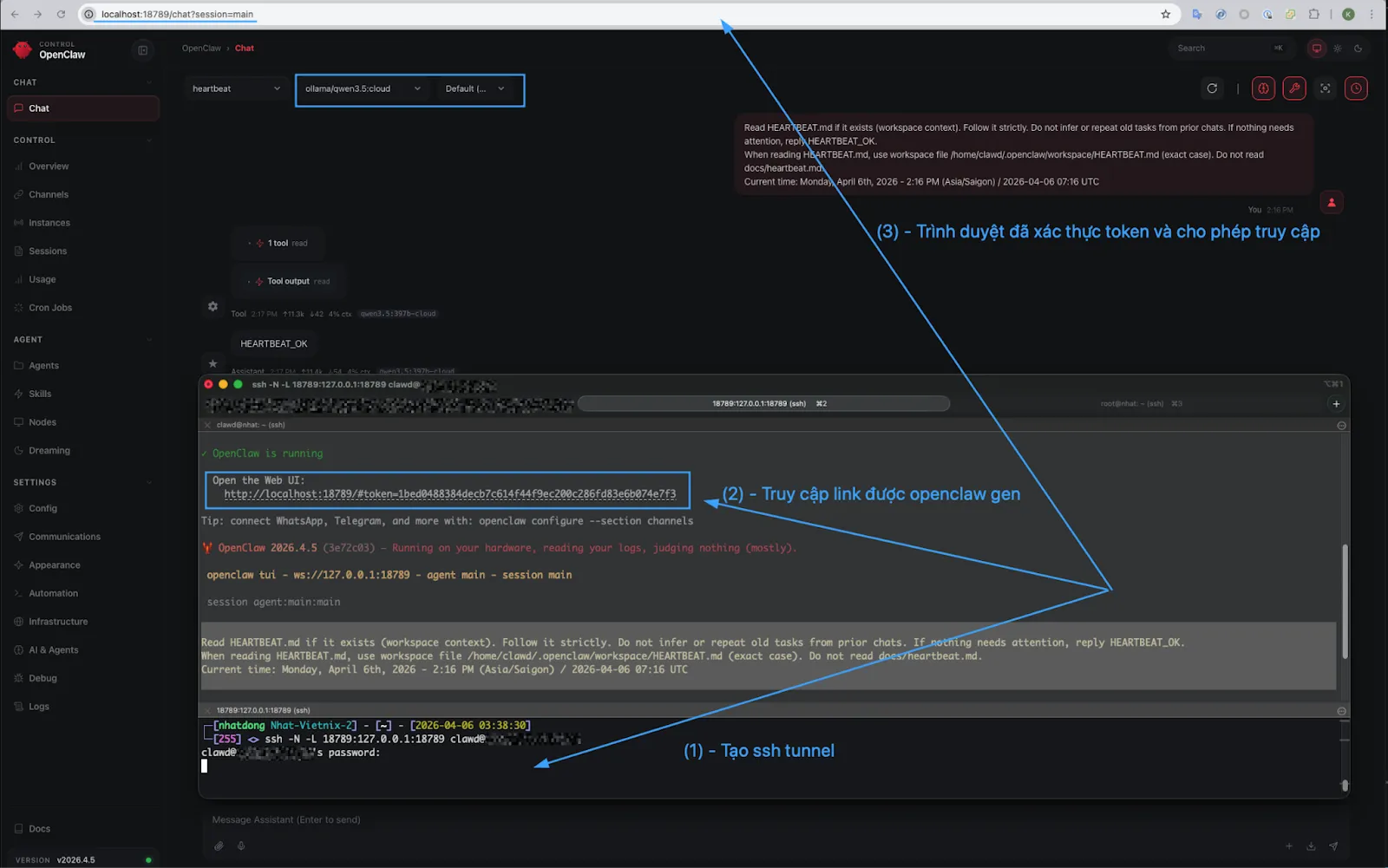

6.2. Tạo SSH Tunnel

Đợi khoảng 2-10 phút để hệ thống cập nhật. Khi hoàn tất, bạn sẽ thấy thông báo link truy cập dạng localhost:18789…

Để truy cập link localhost này từ máy tính cá nhân, bạn cần tạo SSH Tunnel. Mở một Terminal mới trên máy tính cá nhân (không phải trên VPS) và chạy lệnh sau:

ssh -N -L 18789:127.0.0.1:18789 clawd@IP_VPS_Đang_Sử_DụngMẹo: Nếu bạn quên mật khẩu của user clawd, hãy chạy lệnh sudo passwd clawd trên VPS để đặt lại.

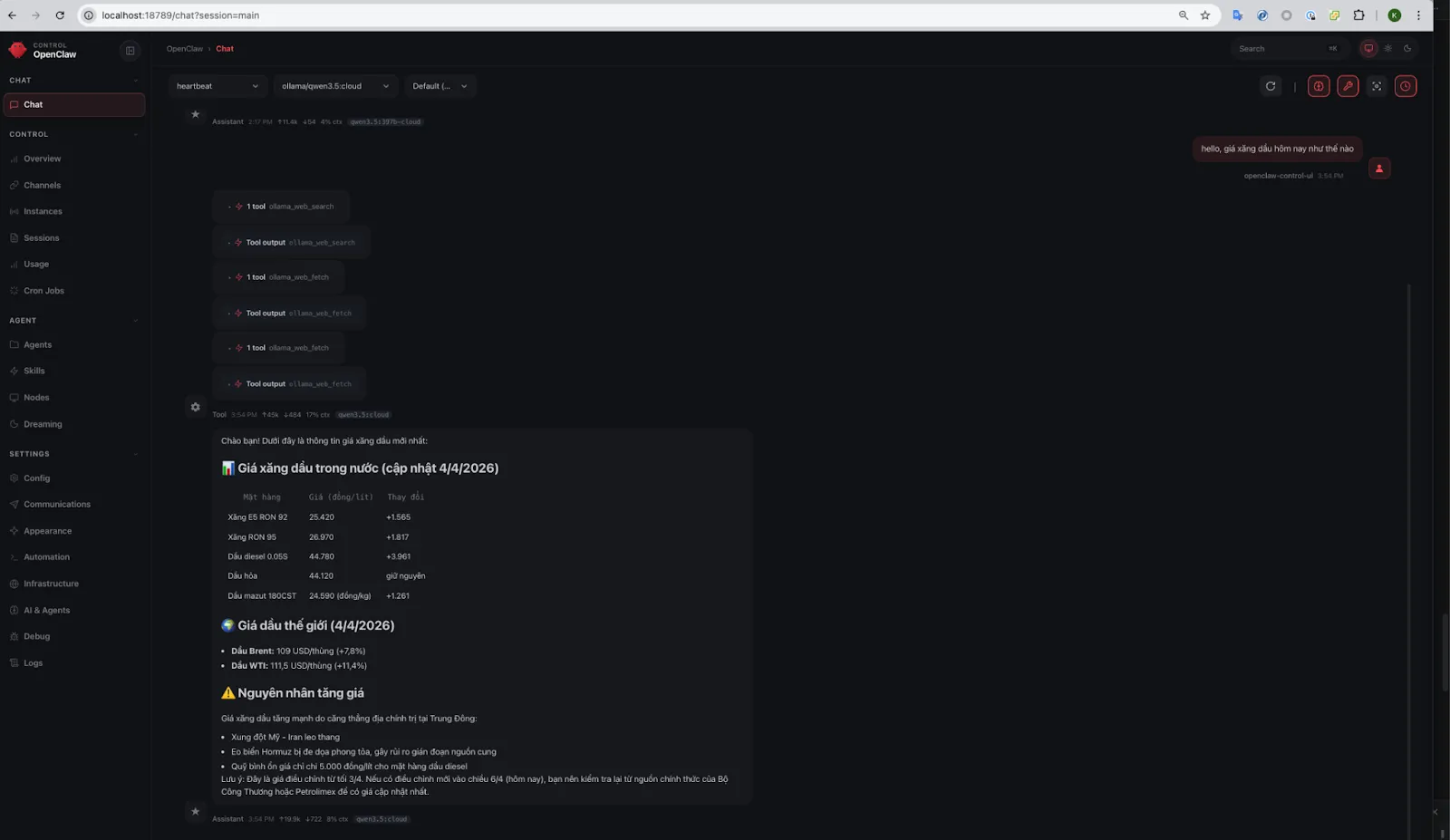

6.3. Bắt đầu trò chuyện

Bây giờ, bạn có thể mở trình duyệt và truy cập http://localhost:18789 để bắt đầu trò chuyện với AI.

Mở rộng: Tích hợp Chatbot vào Telegram

Việc sử dụng SSH Tunnel chỉ phù hợp cho mục đích thử nghiệm, vì kết nối sẽ bị ngắt khi bạn đóng Terminal. Để chatbot AI hoạt động ổn định và có thể sử dụng mọi lúc, mọi nơi trên điện thoại, bạn nên tích hợp trực tiếp với Telegram nhằm biến nó thành một trợ lý AI luôn sẵn sàng phản hồi.

Bước 1: Tạo Telegram Bot

![]() Lưu ý

Lưu ý

Nếu bạn đã có Telegram bot rồi thì có thể bỏ qua bước này và sử dụng Bot Token của Telegram Bot bạn đang sử dụng.

- Mở Telegram, tìm tài khoản

@BotFathervà bắt đầu cuộc trò chuyện. - Gửi lệnh

/newbotvà làm theo hướng dẫn để đặt tên cho bot. - Lưu lại cẩn thận đoạn Bot Token mà BotFather cung cấp. Đây là mã định danh quan trọng để OpenClaw có thể điều khiển bot.

Bước 2: Cấu hình kết nối qua OpenClaw Onboard

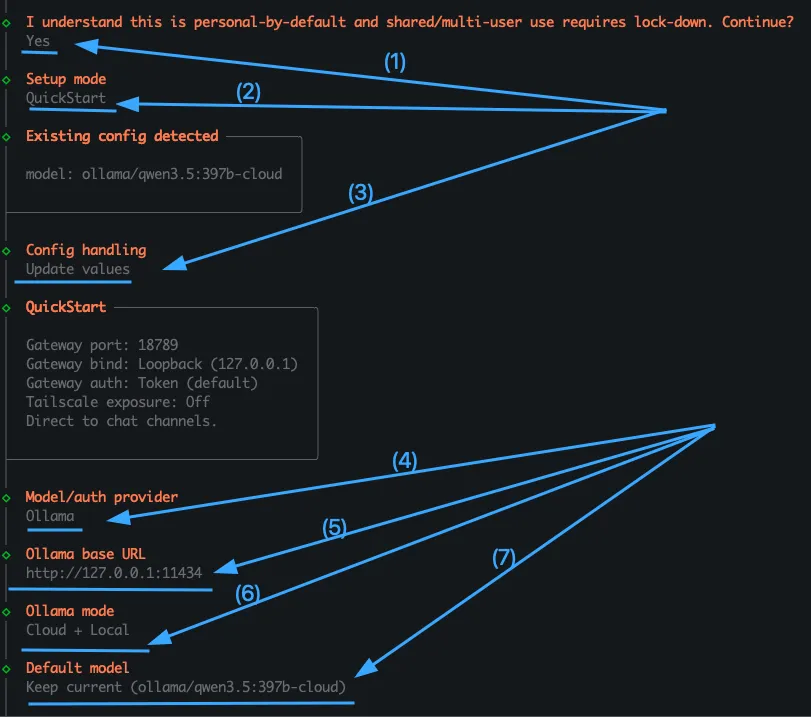

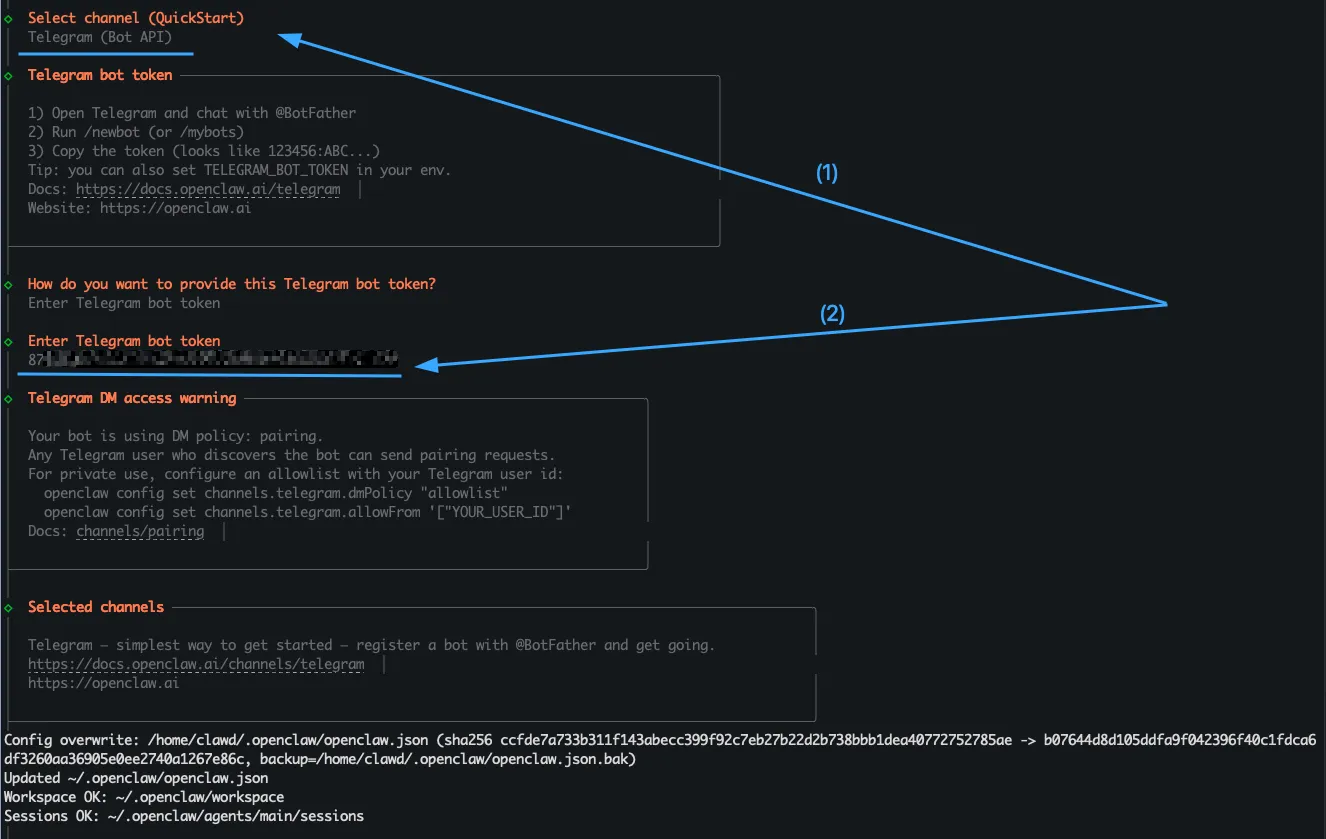

Sử dụng trình hướng dẫn tự động của OpenClaw để kết nối với lệnh: openclaw onboard

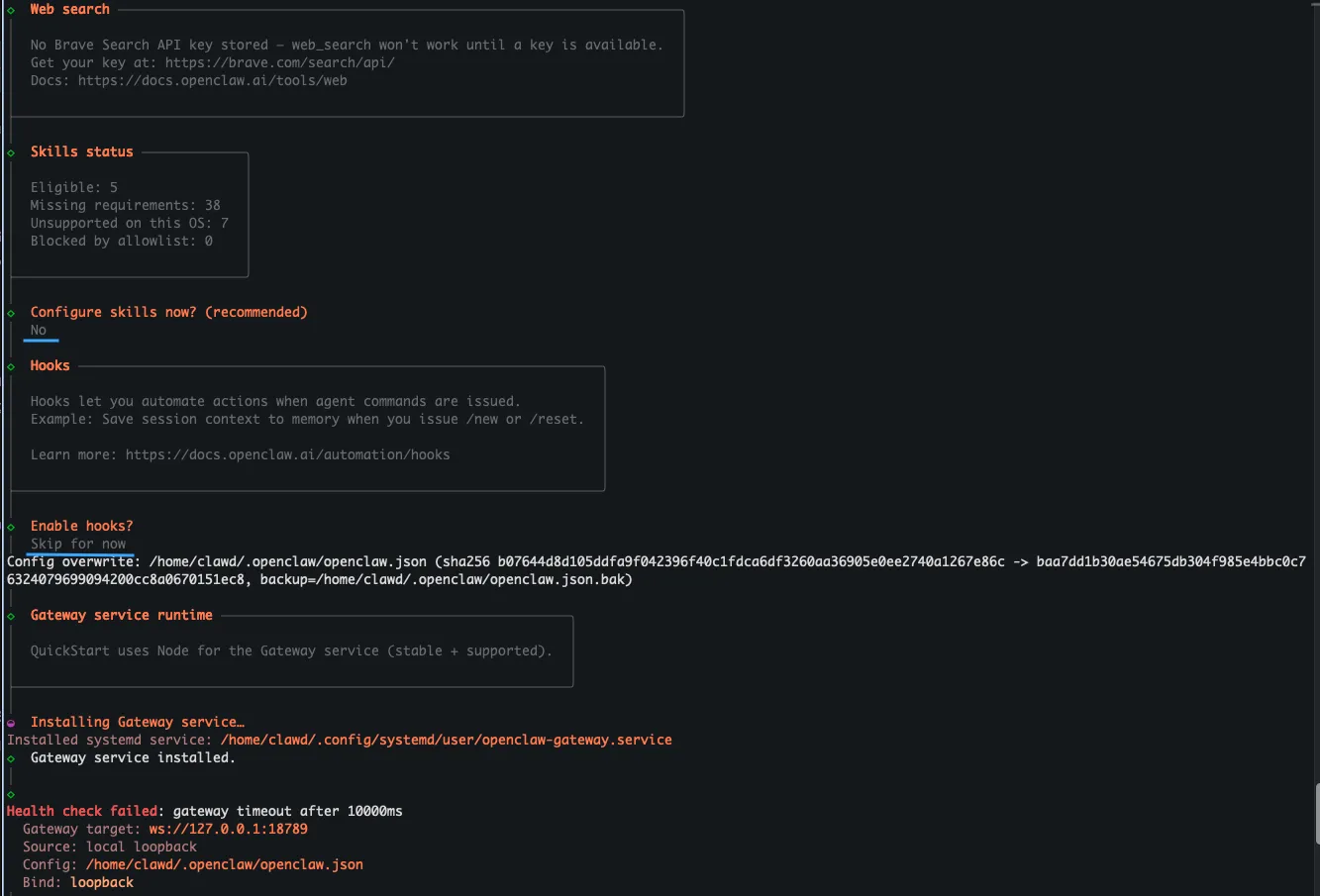

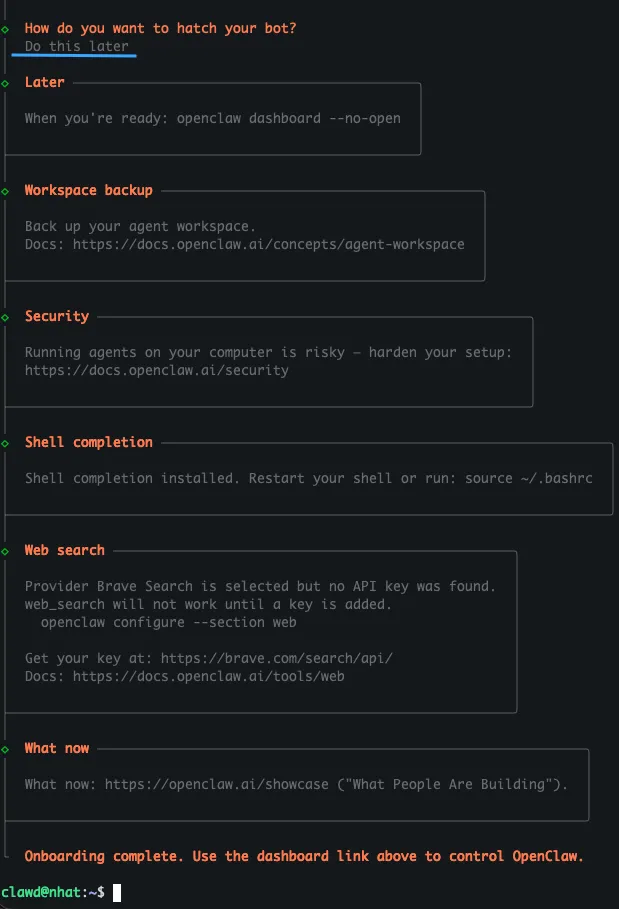

Lần lượt thực hiện các lựa chọn sau trong giao diện dòng lệnh:

I understand this is personal-by-default...:Chọn Yes.Setup mode: Chọn QuickStart.Config handling: Chọn Update values.Model/auth provider: Chọn Ollama.Ollama base URL: Chọn mặc định (http://127.0.0.1:11434).Ollama mode: Chọn Cloud + Local.Default model: Chọn Keep current (giữ lại model bạn đã thiết lập ở bước trước).Select channel (QuickStart): Chọn Telegram (Bot API).Enter Telegram bot token: Dán Bot Token bạn đã lưu ở bước 1 vào đây và nhấn Enter.Search provider: Chọn Brave Search (DuckDuckGo đã bị loại bỏ)Brave Search API key: Nhấn Enter để bỏ trống.Configure skills now?: Chọn No.Enable hooks?: Chọn Skip for now.How do you want to hatch your bot?: Chọn Do this later.

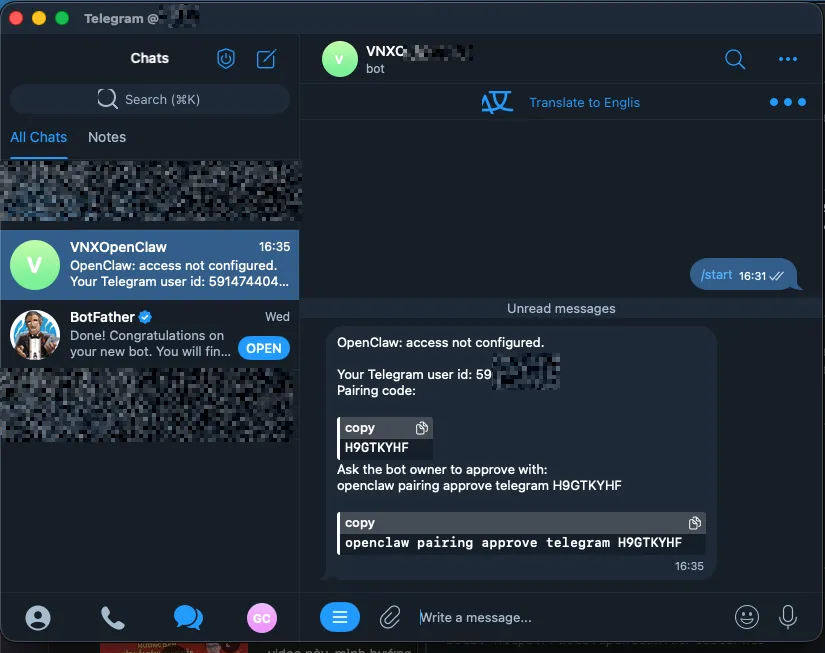

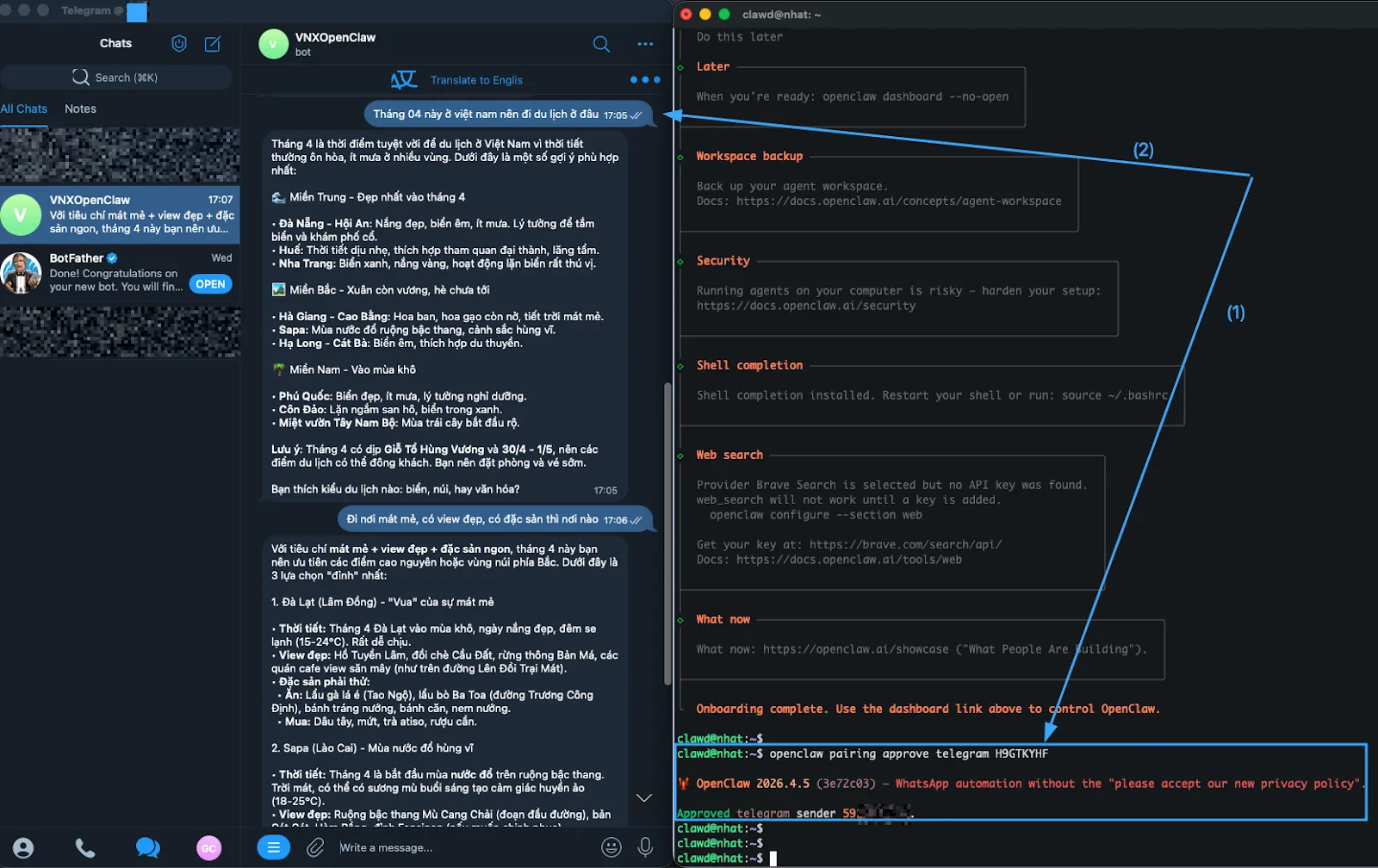

Bước 3: Cấp quyền (Pairing) cho Telegram Bot

- Mở Telegram, tìm đến bot bạn vừa tạo và nhắn một tin bất kỳ.

- Vì lý do bảo mật, bot sẽ không trả lời ngay mà gửi lại một thông báo yêu cầu cấp quyền, kèm theo một mã lệnh có dạng

openclaw pairing approve telegram 12345.... - Sao chép toàn bộ dòng lệnh đó, quay lại cửa sổ SSH trên VPS, dán vào và nhấn Enter.

Như vậy, kết nối đã hoàn tất. Từ bây giờ, bạn có thể trò chuyện với trợ lý AI của mình mọi lúc mọi nơi ngay trên Telegram mà không cần duy trì cửa sổ SSH hay Tunnel phức tạp nữa.

Qua hướng dẫn này, bạn đã nắm được cách thiết lập chatbot AI bằng OpenClaw và Ollama Cloud, từ bước cài đặt đến triển khai thực tế trên Telegram. Đây là một nền tảng rất linh hoạt để bạn tiếp tục mở rộng như tự động hóa, tích hợp API hoặc xây dựng hệ thống AI phục vụ công việc cá nhân. Hy vọng bạn sẽ tận dụng tốt giải pháp này để tạo ra một trợ lý AI hữu ích, hoạt động ổn định và đồng hành cùng bạn mỗi ngày.

VIETNIX – DỊCH VỤ HOSTING, VPS TỐC ĐỘ CAO, ỔN ĐỊNH, BẢO MẬT

- Địa chỉ: 265 Hồng Lạc, Phường Bảy Hiền, Thành Phố Hồ Chí Minh

- Điện thoại: 1800 1093

- Email liên hệ: sales@vietnix.com.vn

- Website: https://vietnix.vn/